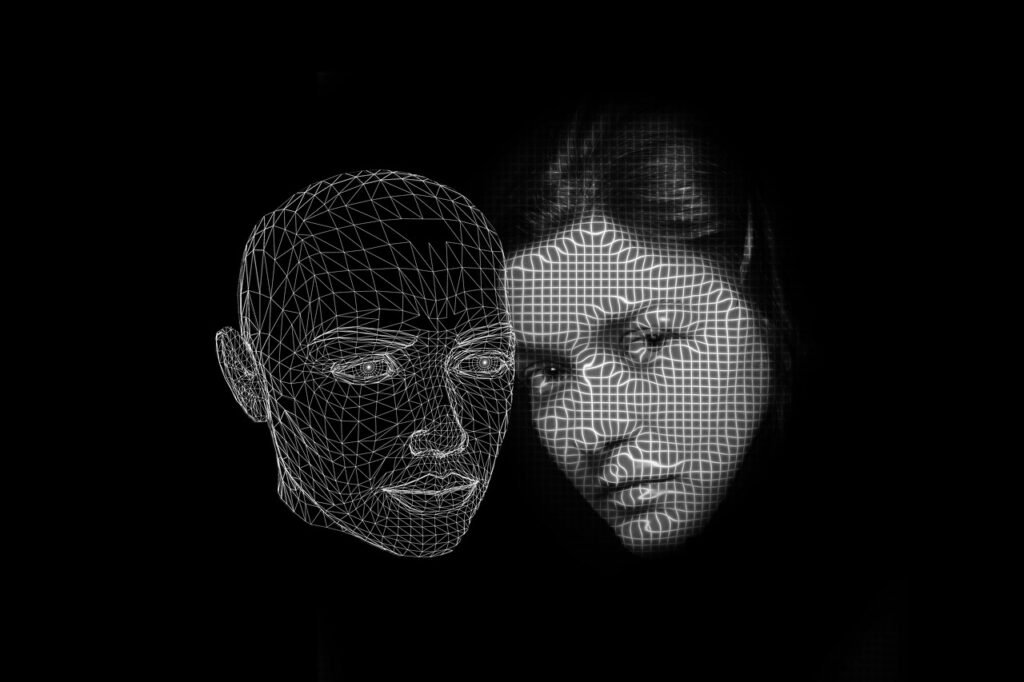

Apparus pour la première fois en 2017, les deepfakes ont révolutionné de nombreux domaines, comme le cinéma, la communication et la formation. Cependant, en tant que technologie capable de créer des images et des vidéos très réalistes, ils posent également de nombreux défis, surtout en matière de protection de la vie privée et de l’image. En effet, utiliser la voix ou le visage d’une personne sans son accord n’est pas sans risques. Face à ce phénomène, quels sont les recours disponibles pour se protéger ? Ce guide répond à vos questions.

Deepfake et IA : de quoi parle-t-on concrètement ?

Le fonctionnement des deepfakes est simple : une IA s’entraîne sur de nombreuses données d’une personne spécifique, puis en génère de nouvelles en superposant la voix ou le visage de cette personne sur une autre. En principe, cette technologie est utilisée à des fins légitimes, comme la reconstitution historique ou le doublage de films. Toutefois, des utilisations abusives ont aussi été source de nombreuses préoccupations.

Par exemple, en 2020, l’ancien président des Etats-Unis, Joe Biden a été victime d’un deepfake intelligence artificielle. En effet, une fausse vidéo le montrant en train de somnoler pendant une interview a été diffusée, ce qui a porté atteinte à son image. Dans de telles situations, faire appel à un avocat propriété intellectuelle paris est essentiel pour défendre ses droits.

Les atteintes au droit à l’image et à la vie privée

Les deepfakes peuvent donner l’impression qu’une personne se trouve dans un contexte inapproprié, grâce aux images et aux vidéos factices. De ce fait, ils peuvent violer le droit à l’image et le droit à la vie privée. Rappelons que le premier protège toute personne contre l’utilisation non autorisée de sa voix ou de son visage, tandis que le second protège son intimité et son identité. Pour approfondir ce sujet, faites une recherche sur : que protège la propriété intellectuelle ?

Dans tous les cas, les victimes d’un deepfake intelligence artificielle peuvent subir un préjudice moral important, car la diffusion d’une image compromettante peut porter atteinte à leur dignité. De plus, cela risque de détruire leur image et leur crédibilité. Enfin, le préjudice professionnel est souvent majeur, car les deepfakes sont susceptibles d’impacter leur carrière et leurs revenus, par exemple dans le cas d’un acteur.

Que dit la loi française sur les deepfakes ?

Le droit à l’image selon le Code civil et pénal

Plusieurs textes légaux régissent l’utilisation des deepfakes :

- selon l’article 226-8 du Code pénal, le fait de « publier, par quelque voie que ce soit, le montage réalisé avec les paroles ou l’image d’une personne sans son consentement, s’il n’apparaît pas à l’évidence qu’il s’agit d’un montage ou s’il n’en est pas expressément fait mention » est sanctionné de 15 000 euros d’amende et d’un an d’emprisonnement ;

- l’article 226-8-1 du Code pénal punit les deepfakes à caractère sexuel de 60 000 euros d’amende et de 2 ans d’emprisonnement. Dans le cas d’une infraction en ligne, la peine d’amende s’élève à 75 000 euros et la peine d’emprisonnement est portée à 3 ans.

Réglementation sur les contenus trompeurs

D’autres lois plus récentes encadrent également l’utilisation de contenus trompeurs. D’une part, la loi Avia de 2020 vise à lutter contre les contenus haineux en ligne en exigeant de les retirer sous 24 heures. D’autre part, le règlement européen DSA ou Digital Services Act impose aux plateformes des obligations de transparence en matière de modération de contenus illicites. Il prescrit de retirer rapidement les deepfakes signalés.

Comment prouver une atteinte en cas d’image générée par IA ?

Collecte de preuves numériques, traçabilité des vidéos / images

La collecte de preuves numériques est l’étape la plus complexe, mais la plus décisive dans une affaire de deepfake intelligence artificielle. Il est important de réunir tous les éléments susceptibles de démontrer l’infraction, comme des captures d’écran, des téléchargements, ainsi que des liens de pages où les contenus sont publiés. N’oubliez pas de dater et d’horodater ces preuves.

Rôle des experts, huissiers et plateformes

Des experts techniques peuvent examiner le deepfake intelligence artificielle pour constater son authenticité. Ils peuvent aussi s’occuper de la traçabilité des vidéos et des images. Par ailleurs, l’intervention d’un huissier de justice est recommandée. Son rôle consiste à dresser un PV de constatation de la diffusion du contenu. Enfin, il est essentiel de signaler les plateformes de la présence d’un deepfake sur leur site. Leur réponse pourra alors servir de preuve, notamment en cas de retrait du contenu.

Quels sont les recours pour les victimes ?

Plusieurs options s’offrent aux victimes de deepfakes pour se défendre :

- droit à l’effacement : en vertu du RGPD, toute personne peut demander à une plateforme de retirer un contenu portant atteinte à ses données personnelles. Cela inclut également l’image ;

- plainte pénale : il est possible de porter plainte contre l’auteur du contenu illicite pour atteinte à l’image et usurpation d’identité. Une enquête sera alors ouverte ;

- procédure en référé : elle permet d’obtenir rapidement le retrait du contenu. Elle est fortement conseillée si celui-ci est diffusé massivement ;

- demande de retrait : la victime peut demander à la plateforme de supprimer un contenu qui viole son intimité. Si celle-ci ignore cette demande, elle pourra être mise en cause ;

- condamnation et réparation financière : si le contenu a porté préjudice à la victime, elle peut demander des dommages et intérêts pour réparation, en plus de la condamnation de l’auteur.

ACBM Avocats : défendre votre image à l’ère des IA et des deepfakes

De plus en plus de personnes utilisent les deepfakes à des fins douteuses. Pour préserver votre image et votre réputation, contactez ACBM Avocats dès maintenant. Grâce à un accompagnement juridique sur mesure, vous serez protégé efficacement en cas d’usurpation d’identité ou de deepfake intelligence artificielle. Nous constituerons un dossier solide et élaborerons une stratégie de défense pertinente.

Notre expertise nous permet d’effectuer une analyse approfondie des enjeux juridiques et médiatiques de chaque cas. De plus, nous pouvons mettre en place des actions personnalisées selon la gravité et la diffusion du contenu. Nous choisirons la meilleure option pour faire valoir vos droits et défendre votre image.